Генерация ДЗ как удобный способ обойти систему

Школьные домашние задания и контрольные работы не всегда проверяют понимание предмета. Часто они показывают, умеет ли ученик выполнять формальные требования и соответствовать ожиданиям учителя. В такой ситуации задания начинают восприниматься не как проверка усвоенного материала или отработка навыка, а как формальная процедура, которую можно оптимизировать. В результате школьники ищут легкие способы выполнить задачу — списывают или генерируют решение. Развитие нейросетей не создало эту проблему, но сделало ее заметнее.

Обычно проблему читинга обсуждают в терминах академической честности [1]. В таких дискуссиях чаще всего говорят о рисках и предлагают решения, которые, как правило, связаны с запретами и новыми формами контроля [2]. Но такой подход плохо объясняет, что происходит в обычной школьной жизни и почему ученики используют ИИ для выполнения домашних заданий.

Опросы старшеклассников и студентов показывают, что использование нейросетей чаще воспринимается ими не как академическое нарушение, а как удобный способ сократить время на выполнение рутинных заданий [3, 4]. Так школьные правила вступают в противоречие с реальными учебными практиками. Именно этот конфликт, а не технологии сами по себе, и является ключевой проблемой.

Списывание до нейросетей

Школьники массово списывали задолго до появления смартфонов и ChatGPT. В опросах 1960–1980-х годов большинство американских старшеклассников признавались, что пользуются шпаргалками, и почти все из них говорили, что регулярно видят, как списывают другие [5]. Причем причины этого никак не связаны ни с «плохими» или немотивированными учениками, ни с развитием технологий.

Когда школьников спрашивают, почему они списывают, они редко говорят о лени или отсутствии моральных принципов. Гораздо чаще звучат вполне рациональные причины:

- страх плохих оценок;

- давление со стороны школы и родителей;

- хроническая нехватка времени;

- перегруженность заданиями.

Академическая нечестность в такой ситуации оказывается способом справиться с высокими ставками и ограниченными ресурсами.

Важную роль играет и эффект «равных условий» (англ. leveling the playing field). Если ученики видят, что другие списывают и получают за это высокие оценки, отказ от шпаргалок воспринимается как проигрышная стратегия. Списывание постепенно становится нормой, причем настолько привычной, что ее почти перестают замечать. В этом смысле оно поощряется самой образовательной средой, в которой давление и конкуренция превалируют над получением знаний.

Генеративный ИИ как учебный инструмент

Появление ChatGPT часто описывают как переломный момент в академической честности. Однако, как показывает исследование 2023 года среди 399 студентов университетов Гонконга, общий уровень читинга среди учащихся остается примерно таким же, что и до развития нейросетей [6]. При этом сами учащиеся обычно различают допустимые и недопустимые способы использования ИИ.

В том же опросе студенты описывали нейросети скорее как вспомогательный инструмент. Больше половины опрошенных считали допустимым использовать ИИ для генерации идей, изображений, кода, объяснения сложных понятий, но абсолютное большинство (от 86 до 95% респондентов) говорили о том, что не будут применять нейросети для того, чтобы полностью сделать текст письменной работы [6]. Похожие результаты показали опросы британских и американских студентов [7].

В других исследованиях ИИ называется «виртуальным репетитором», который помогает снизить учебную нагрузку, но не заменяет самостоятельное и критическое мышление [3].

Нейросети изменили не масштаб академической нечестности, а ее логику. Если раньше списывание было скрытой и рискованной практикой, то использование ИИ становится повседневным и во многом нормализованным. Граница между допустимой помощью и нарушением правил размывается, особенно там, где школьные правила не успевают за технологиями и формулируются постфактум. Это ставит перед школами вопрос, как в новых условиях переосмыслить понятие академической честности и инструменты оценки образовательных результатов.

Детекторы ИИ: ограничения и предвзятость

Одним из ответов на распространение ИИ стали детекторы сгенерированных текстов. Предполагается, что с их помощью можно восстановить границы академической честности и отличить «человеческую» работу от машинной. Однако исследования показывают, что эта стратегия плохо работает и технически, и социально.

Эксперименты, сравнивающие разные типы детекторов, показывают, что их легко обойти даже с помощью обычного повторного перефразирования [9]. Можно предположить, что по мере того, как сгенерированные тексты будут все больше напоминать человеческие, их надежное обнаружение при помощи цифровых инструментов станет нерешаемой задачей.

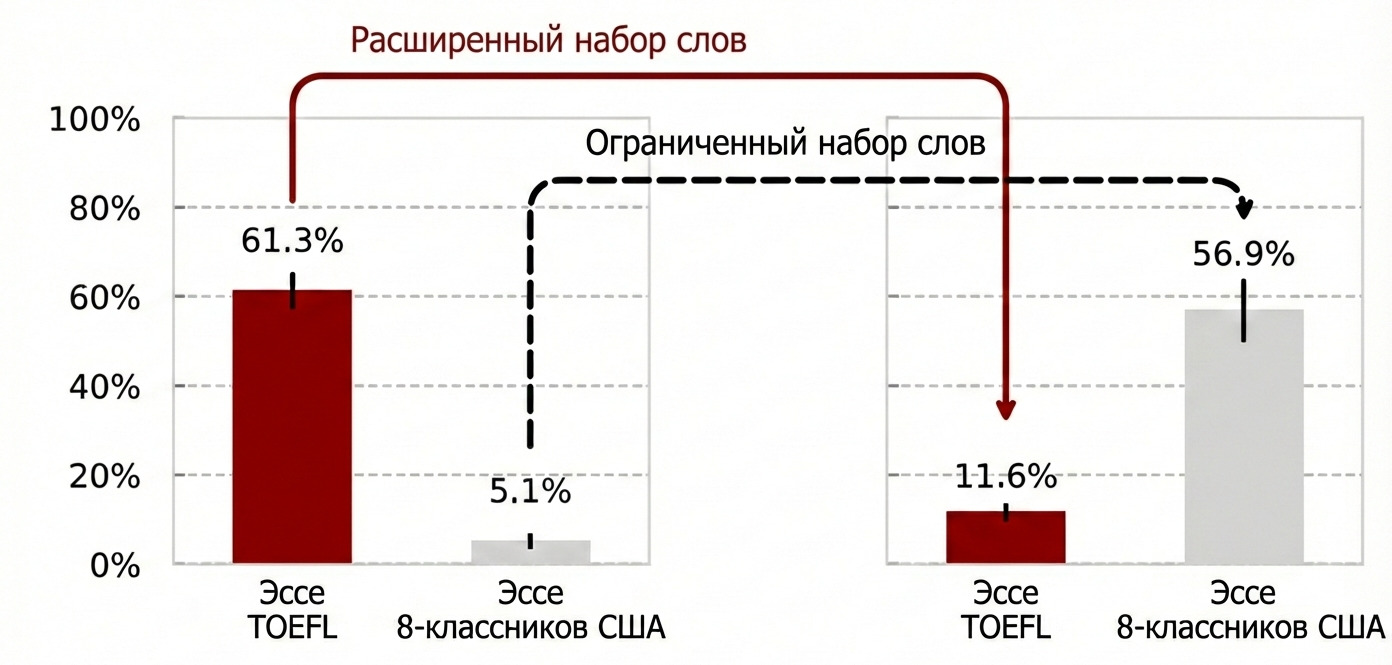

Другие исследования подтверждают, что детекторы систематически ошибаются, когда проверяют тексты, созданные не на родном языке авторов. При оценке детекторы часто полагаются на статистические метрики вроде перплексии1 текста, которая ниже для текстов с ограниченным лексическим разнообразием. Поскольку это характерно для многих пишущих не на родном языке, их работы попадают под подозрение. В одном из экспериментов, после искусственного «обогащения» словаря в эссе неносителей, уровень ложных обвинений со стороны детекторов упал с 61 до 12% [10]. Это демонстрирует, что детекторы реагируют на стилистические особенности, а не на факт генерации ИИ, что повышает риск ложных обвинений и дискриминации.

Более того, сами попытки улучшить детекторы приводят лишь к «гонке вооружений»: более сложные нейросетевые модели требуют постоянного обновления и плохо масштабируются в реальной образовательной практике [11]. В результате автоматизированный контроль за генерацией домашних заданий только подрывает доверие между учениками и школой. При этом он не помогает бороться с причинами академической нечестности.

- Перплексия (англ. perplexity) — метрика, показывающая, насколько легко языковая модель может предсказать и воспроизвести проверяемый текст. Чем ниже перплексия, тем более предсказуемым считается текст. Детекторы ИИ часто интерпретируют низкую перплексию как признак генерации. Проблема в том, что тексты неносителей языка, в силу более простой лексики и грамматики, также имеют низкую перплексию, что ведет к ложному определению таких текстов как сгенерированных. ↩︎

Нечестность как зеркало системы оценивания

Если выполнение задания можно быстро и качественно автоматизировать с помощью ИИ, это не обязательно говорит о нечестности учеников — скорее о том, что именно проверяет задание.

В отчете австралийского агентства TEQSA (Tertiary Education Quality and Standards Agency) предлагается рассматривать ИИ как «стресс-тест» системы оценивания [12]. Нейросети легко справляются с заданиями, в которых нужно следовать шаблону и воспроизводить стандартные аргументы, но они ограничены там, где требуется контекстное мышление, рефлексия и принятие решений. Исследователи из учебного заведения Kaplan Singapore также считают, что стандартные письменные работы уязвимы перед нейросетями именно потому, что давно используются как проверка соответствия формальным требованиям [13]. Иными словами, проблема заключается не в том, что ИИ «слишком умный», а в том, что традиционное оценивание не различает уровни когнитивной работы.

Это подтверждают и данные опросов: школьники чаще используют ИИ в заданиях, которые сами считают шаблонными или избыточными, и реже — там, где работа воспринимается как действительно значимая. Авторы названных исследований [3, 12] относят к шаблонным:

- стандартные сочинения и рефераты, где важен лишь итоговый текст или его структура, а не сам процесс создания;

- ответы на вопросы, которые легко найти в открытых источниках;

- типовые задачи и упражнения;

- обзоры, которые не требуют глубокого критического анализа или выражения личной позиции.

Решением может стать внедрение заданий иного типа. Например:

- контекстные задачи, связанные с анализом смоделированных кейсов или актуальных событий;

- задания, требующие личного опыта и рефлексии (например, написание сочинений с анализом собственного учебного опыта, ошибок или принятых решений);

- задания, где нужно объяснить ход мыслей и решения (например, предоставление черновых вариантов, записей размышлений, обоснований выбора источников);

- групповые проекты с распределением ролей, создание видео, подкастов, презентаций, публичных выступлений и др.;

- задания, где требуется использовать ИИ, а затем оценить его работу или сравнить его данные с альтернативными источниками.

В результате читинг в эпоху ИИ перестает быть вопросом индивидуальной этики и становится отражением системы оценивания. Если она вознаграждает простое соответствие, учащиеся выбирают инструменты, которые позволяют достигать этих целей с минимальными затратами. Но если школы и институты будут поощрять критическое мышление, осмысление личного опыта, этот же инструмент можно направить на совершенствование обучения, а не его имитацию.

Как меняются роли ученика и учителя

Распространение ИИ помогает ученику быть активным участником образовательного процесса. Учащиеся все чаще сами выстраивают свое обучение: планируют время, выбирают цифровые инструменты и решают, где и как их использовать. В интервью и опросах они описывают ИИ как инструмент самоорганизации, но при этом подчеркивают, что им не хватает ясных правил и подсказок со стороны образовательных институций [3].

Для преподавателей ситуация выглядит не менее противоречиво. С одной стороны, ИИ воспринимается как потенциальный помощник. С другой — он увеличивает нагрузку и усиливает чувство неопределенности, особенно в условиях отсутствия поддержки со стороны школ или университетов [14, 15]. Преподавателю приходится балансировать между необходимостью сохранять контроль, обеспечивать честность и при этом не превращать обучение в бесконечную проверку того, самостоятельно ли ученик выполнил задание.

В отчете австралийского национального агентства по регулированию и обеспечению качества высшего образования (TEQSA) позиция преподавателя в новых условиях описывается как переход от роли контролера к роли проектировщика учебных ситуаций [12]. Однако даже авторы отчета признают, что это невозможно без уменьшения нагрузки, пересмотра стандартов образования и признания того, что отдельный преподаватель не может в одиночку решить системную проблему. До тех пор ИИ будет оставаться катализатором уже существующих противоречий между учениками, преподавателями и системой в целом.

Нейросеть как индикатор качества образования

Использование нейросетей показывает, как легко автоматизируется выполнение заданий, построенных на соответствии шаблонам. В этой ситуации читинг с помощью ИИ оказывается прямым следствием того, как устроены учебные требования.

Попытки ответить на этот вызов через запреты и детекторы не только не решают проблемы, но и усугубляют ее. Возможность легко выполнить задание с помощью ИИ выступает индикатором того, какие инструменты оценивания действительно связаны с мышлением, а какие существуют лишь как формальность.

В итоге разговор об обходе учебных требований в эпоху ChatGPT — это уже разговор не о поимке нарушителей и хитрецов. Это спор о самом важном — что, в конечном счете, мы хотим проверить и чему научить?

Источники

- Сысоев П.В. Этика и ИИ-плагиат в академической среде: понимание студентами вопросов соблюдения авторской этики и проблемы плагиата в процессе взаимодействия с генеративным искусственным интеллектом // Высшее образование в России. 2024. Т. 33. № 2. С. 31–53. URL: https://vovr.elpub.ru/jour/article/view/4804/2335 (дата обращения: 09.01.2026).

- Marks L. What 2025 generative AI trends reveal about student behavior [Электронный ресурс] // Turnitin. 2025. URL: https://www.turnitin.com/blog/what-2025-generative-ai-trends-reveal-about-student-behavior (дата обращения: 09.01.2026).

- Chan C., Hu W. Students’ voices on generative AI: perceptions, benefits, and challenges in higher education. International Journal of Educational Technology in Higher Education // International Journal of Educational Technology in Higher Education. 2023. Vol. 20. Article number: 43. DOI: 10.1186/s41239-023-00411-8. URL: https://www.researchgate.net/publication/372411790_Students’_voices_on_generative_AI_perceptions_benefits_and_challenges_in_higher_education (дата обращения: 09.01.2026).

- Teens, Social Media and AI Chatbots 2025 // Pew Research Center. 2025. URL: https://www.pewresearch.org/wp-content/uploads/sites/20/2025/12/PI_2025.12.09_Teens-Social-Media-AI_REPORT.pdf (дата обращения: 09.01.2026).

- McCabe D. L., Butterfield K. D., Treviño L. K. Cheating in college: Why students do it and what educators can do about it. Baltimore: Johns Hopkins University Press, 2012. 225 p.

- Lee V., Pope D., Miles S., Zárate R. Cheating in the age of generative AI: A high school survey study of cheating behaviors before and after the release of ChatGPT // Computers and Education: Artificial Intelligence. 2024. Vol. 7. 100253. URL: https://www.sciencedirect.com/science/article/pii/S2666920X24000560 (дата обращения: 13.01.2026).

- Marks L. What 2025 generative AI trends reveal about student behavior // Turnitin. 2025. URL: https://www.turnitin.com/blog/what-2025-generative-ai-trends-reveal-about-student-behavior (дата обращения: 15.01.2026).

- Anketolog.ru: более 60% российских школьников используют нейросети для учебы // ТАСС. 01.09.2025. URL: https://tass.ru/obschestvo/24920961 (дата обращения: 17.01.2026).

- Sadasivan V. S., Kumar A., Balasubramanian S., Wang W., Feizi S. Can AI-Generated Text be Reliably Detected? // arXiv. 2023. 2303.11156. URL: https://arxiv.org/abs/2303.11156 (дата обращения: 17.01.2025).

- Liang W., Yuksekgonul M., Mao Y. et al. GPT detectors are biased against non-native English writers // Patterns. 2023. Vol. 4. Issue 7. 100779. URL: https://www.sciencedirect.com/science/article/pii/S2666389923001307 (дата обращения: 17.01.2025).

- Masrour E., Emi B., Spero M. DAMAGE: Detecting Adversarially Modified AI Generated Text // arXiv. 2025. 2501.03437. URL: https://arxiv.org/abs/2501.03437 (дата обращения: 17.01.2025).

- Assessment reform for the age of artificial intelligence // TEQSA. 2023. URL: https://www.teqsa.gov.au/guides-resources/resources/corporate-publications/assessment-reform-age-artificial-intelligence (дата обращения: 17.01.2025).

- Rudolph J., Tan S., Tan S. ChatGPT: Bullshit Spewer or the End of Traditional Assessments in Higher Education? // Journal of Applied Learning and Teaching. 2023. Vol. 6. N. 1. P. 342–363. URL: https://journals.sfu.ca/jalt/index.php/jalt/article/view/689 (дата обращения: 17.01.2025).

- Ng D. T. K., Chan E. K. C., Lo C. K. Opportunities, challenges and school strategies for integrating generative AI in education // Computers and Education: Artificial Intelligence. 2025. Vol. 8. N. 6. 100373. URL: https://www.researchgate.net/publication/388391112_Opportunities_Challenges_and_School_Strategies_for_Integrating_Generative_AI_in_Education (дата обращения: 17.01.2025).

- Токтарова В.И., Ребко О.В. ChatGPT в работе педагога: возможности и риски использования // Цифровая гуманитаристика и технологии в образовании (DHTE 2023): сб. статей IV Международной научно-практической конференции. М.: ФГБОУ ВО МГППУ, 2023. С. 421–430. URL: https://psyjournals.ru/nonserialpublications/dhte2023/contents/Toktarova_Rebko (дата обращения: 17.01.2025).